KI-Haftungsrichtlinie

1. Ziele der geplanten KI-Haftungsrichtlinie

Verbraucher*innen, vor allem auch Patient*innen, sind bei KI-Lösungen noch recht skeptisch. Die aktuelle TÜV-Umfrage zeigt, dass zwar allgemein Chancen durch KI-Anwendungen für die Gesundheit gesehen werden, hinsichtlich einer richtigen Diagnosestellung durch eine KI-Lösung aber Bedenken bestehen. Ein klarer gesetzlicher Rahmen, um Risiken im sensiblen Gesundheitswesen zu minimieren und für Verlässlichkeit zu sorgen, kann diese Bedenken mindern. Das übergeordnete Ziel der geplanten KI-Haftungsrichtlinie ist auch die Förderung der Einführung vertrauenswürdiger KI, um ihre Vorteile voll auszuschöpfen. Nach dem Willen des europäischen Gesetzgebers soll die neue Regulierung:

- sicherstellen, dass die Haftungsregeln die Art und die Risiken von Produkten im digitalen Zeitalter und in der Kreislaufwirtschaft widerspiegeln;

- sicherstellen, dass es immer ein Unternehmen mit Sitz in der EU gibt, das für fehlerhafte Produkte haftbar gemacht werden kann, die direkt von Herstellern außerhalb der EU gekauft wurden, da die Verbraucher immer häufiger Produkte direkt aus Nicht-EU-Ländern kaufen, ohne dass es einen Hersteller oder Importeur mit Sitz in der EU gibt;

- die Beweislast in komplexen Fällen erleichtern sowie Beschränkungen bei der Geltendmachung von Ansprüchen bei gleichzeitiger Gewährleistung eines gerechten Ausgleichs zwischen den legitimen Interessen der Hersteller, der Geschädigten und der Verbraucher erleichtern;

- die Rechtssicherheit gewährleisten, indem das Verleihrecht besser an den durch den Beschluss 768/2008/EG7 geschaffenen neuen Rechtsrahmen und an die Produktsicherheitsvorschriften angepasst wird und die Rechtsprechung zum Verleihrecht kodifiziert wird.

Die geplante KI-Haftungsrichtlinie zielt demnach darauf ab, einheitliche Regeln für den Zugang zu Informationen zu schaffen und die Erleichterung der Beweislast im Zusammenhang mit durch KI-Systeme verursachten Schäden festzulegen. Es soll ein umfassenderer Schutz für Geschädigte (sowohl Einzelpersonen als auch Unternehmen) eingeführt werden und daneben noch die Förderung des KI-Sektors durch Stärkung der Garantien erfolgen.

2. Stufenweise Einführung der KI-Haftungsrichtlinie

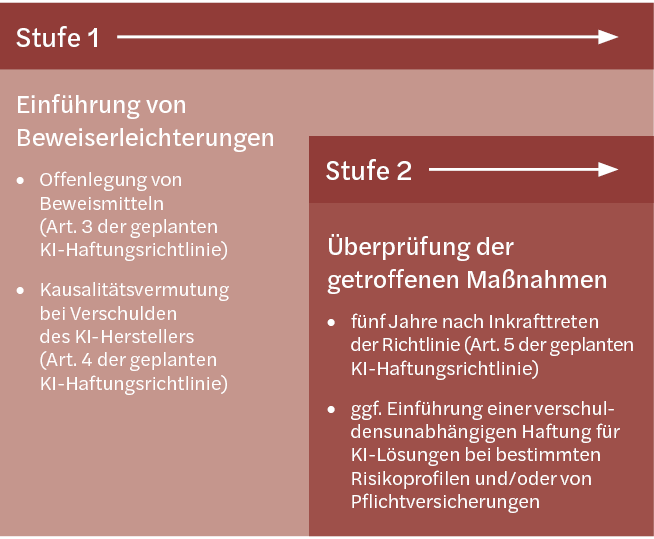

Die geplante KI-Haftungsrichtlinie soll stufenweise eingeführt werden. In der ersten Stufe, die die Einführung von Beweislasterleichterungen bei KI-Haftung vorsieht, sollen die festgelegten Ziele mit einem minimalinvasiven Ansatz (minimally invasive approach) erreicht werden. In der zweiten Stufe, die sich auf die Prüfung der Erforderlichkeit weiterer Maßnahmen bezieht, wird u. a. bewertet, ob die Einführung einer verschuldensunabhängigen Haftung für KI-Lösungen bei bestimmten Risikoprofilen oder auch von Pflichtversicherungen notwendig ist. Die Überprüfung soll fünf Jahre nach Inkrafttreten der Richtlinie erfolgen.

3. Die geplanten Beweiserleichterungen

Die Richtlinie hat das Ziel, den Nachweis, dass die KI-Lösung bei dem Anspruchssteller zu einem Schaden geführt hat, durch die Einführung der folgenden zwei Elemente zu erleichtern:

- Offenlegung von Beweismitteln (Art. 3 der geplanten KI-Haftungsrichtlinie)

- Kausalitätsvermutung bei Verschulden des KI-Herstellers (Art. 4 der geplanten KI-Haftungsrichtlinie

Bei hochriskanten KI-Systemen, die im Verdacht stehen, einen Schaden verursacht zu haben, ist vorgesehen, dass das Gericht die Offenlegung relevanter Beweise anordnen kann. Die Offenlegungspflicht setzt allerdings voraus, dass der Geschädigte Tatsachen und Beweismittel vorlegt, die die Plausibilität des Schadensersatzanspruchs belegen, und bereits versucht hat, die einschlägigen Beweise vom Beklagten zu erlangen. Das Ersuchen wird sich in erster Linie an den Beklagten, also i. d. R. den Anbieter (provider) oder den Nutzer (user) des KI-Systems, i. S. d. KI-Verordnung richten. Entscheidend ist für die Anordnung der Offenlegung der tatsächliche Zugang zu den Beweismitteln durch den Betroffenen. Richtet sich die Klage primär gegen den Betreiber des KI-Systems, kann das Beweisaufnahmeersuchen auf den KI-Hersteller erweitert werden. Das Gericht kann zudem die Sicherstellung der Beweise anordnen. Bei der Anordnung muss der Grundsatz der Verhältnismäßigkeit (Beschränkung der Offenlegung auf das notwendige Minimum) eingehalten werden.

Im Hinblick auf die Komplexität der KI-Systeme kann sich der Kausalitätsnachweis zwischen dem eingetretenen Schaden und dem Verschulden des Beklagten in der Praxis besonders schwierig gestalten. Diese Problematik erkennt der europäische Gesetzgeber und plant, dem Geschädigten mit dem Instrument der widerlegbaren Kausalitätsvermutung zu helfen. Wird ein Verschulden des Beklagten beim Einsatz eines KI-Systems mit hoher Risikoklasse festgestellt, so wird der Anspruchssteller dank der Kausalitätsvermutung nicht mehr den Zusammenhang zwischen dem Schaden und der Handlung oder einer bestimmten Unterlassung erklären müssen. Hierdurch soll dem Geschädigten der Zugang zum Schadensersatz vereinfacht werden, denn i. d. R. stehen dem Kläger keine ausreichenden Beweise und Fachkenntnisse zur Verfügung, um den Kausalzusammenhang zu beweisen.

Allerdings kann der Beklagte diese Vermutungsregelung aushebeln, wenn er nachweisen kann, dass dem Kläger ausreichende Beweise und Fachkenntnisse zur Verfügung stehen, um den Kausalzusammenhang zu beweisen. Diese Möglichkeit soll vor allem den Anreiz schaffen, die in der geplanten KI-Verordnung festgestellten Maßnahmen zur Gewährleistung eines hohen Maßes an Transparenz der KI oder die Dokumentations- und Aufzeichnungspflichten zu erfüllen sowie ihrer Offenlegungspflichten nachzugehen.

Ferner gibt es zwei weitere Einschränkungen: Bei KI-Produkten mit geringerer Risikoklasse soll die Kausalitätsvermutung nur dann gelten, wenn das Gericht der Ansicht ist, dass es für den Kläger übermäßig schwierig sein wird, den Kausalzusammenhang nachzuweisen. Wird das KI-System zudem lediglich im Rahmen einer persönlichen, nicht beruflichen Tätigkeit genutzt, so soll die Vermutung nur dann gelten, wenn der Beklagte die Betriebsbedingungen des KI-Systems wesentlich beeinträchtigt hat oder wenn der Beklagte die Betriebsbedingungen des KI-Systems festlegen musste und konnte, dies aber unterlassen hat.

4. Weitere Regelungen

Der europäische Gesetzgeber denkt diesmal weiter als in vielen anderen Gesetzesvorhaben und übernimmt die die KI betreffenden Definitionen aus dem Vorschlag zu der KI-Verordnung. Somit wird für eine begriffliche Kohärenz gesorgt. So unterscheiden die neuen Vorschriften konsequenterweise auch zwischen Ansprüchen gegen den Anbieter eines risikoreichen KI-Systems und gegen den Nutzer solcher Systeme (vgl. Art. 4 Abs. 2 und Abs. 3 der geplanten KI-Haftungsrichtlinie).

Es werden darüber hinaus auch weitere Definitionen eingeführt, wie beispielweise die Definition des Klägers. Mit der Einführung der Definition des Klägers (claimant) stellt die geplante Richtlinie klar, dass, soweit dies dem nationalen Recht nicht widerspricht, die Ansprüche auch im Rahmen einer Sammelklage verfolgt werden können. Das deutsche Zivilrecht kennt den Begriff der Sammelklage nicht, sieht allerdings die Möglichkeit vergleichbarer Prozessformen, wie einer aktiven Streitgenossenschaft oder der Musterfeststellungsklage, die im Rahmen des VW-Skandals populär wurde. Beide Formen sind an einige spezielle Voraussetzungen geknüpft. So muss bei der Streitgenossenschaft beispielsweise die Rechtsgemeinschaft hinsichtlich des Streitgegenstandes oder die Identität des Anspruchs- oder Verpflichtungsgrundes bestehen (vgl. §§ 59 ff. ZPO). Die Musterfeststellungklage kann generell nur von Verbraucherverbänden, wie z. B. VZBV oder ADAC eingereicht werden (vgl. §§ 606 ff. ZPO).

5. Fazit

Das Gesetzesvorhaben der EU-Kommission zielt auf die Herstellung eines ausgewogenen Verhältnisses zwischen dem Schutz der Verbraucher und der Förderung von Innovationen ab. Die neuen Vorschriften sollen sicherstellen, dass durch KI-Produkte oder -Dienste die Geschädigten von denselben Schutzstandards profitieren wie bei unter anderen Umständen verursachten Schäden, die nicht auf innovativen Technologien beruhen. Im Ergebnis ist die Einführung solcher Vorschriften wichtig und notwendig, um eine allgemeine Akzeptanz für die KI-Lösungen zu erreichen.

Haben Sie Fragen oder weiteren Informationsbedarf?

Autorin

Sonia Seubert

Tel: + 49 30 208 88 1039

Dies ist ein Beitrag aus unserem Healthcare-Newsletter 4-2022. Die gesamte Ausgabe finden Sie hier. Sie können diesen Newsletter auch abonnieren und erhalten die aktuelle Ausgabe direkt zum Erscheinungstermin.